Última actualización: 17/01/2026

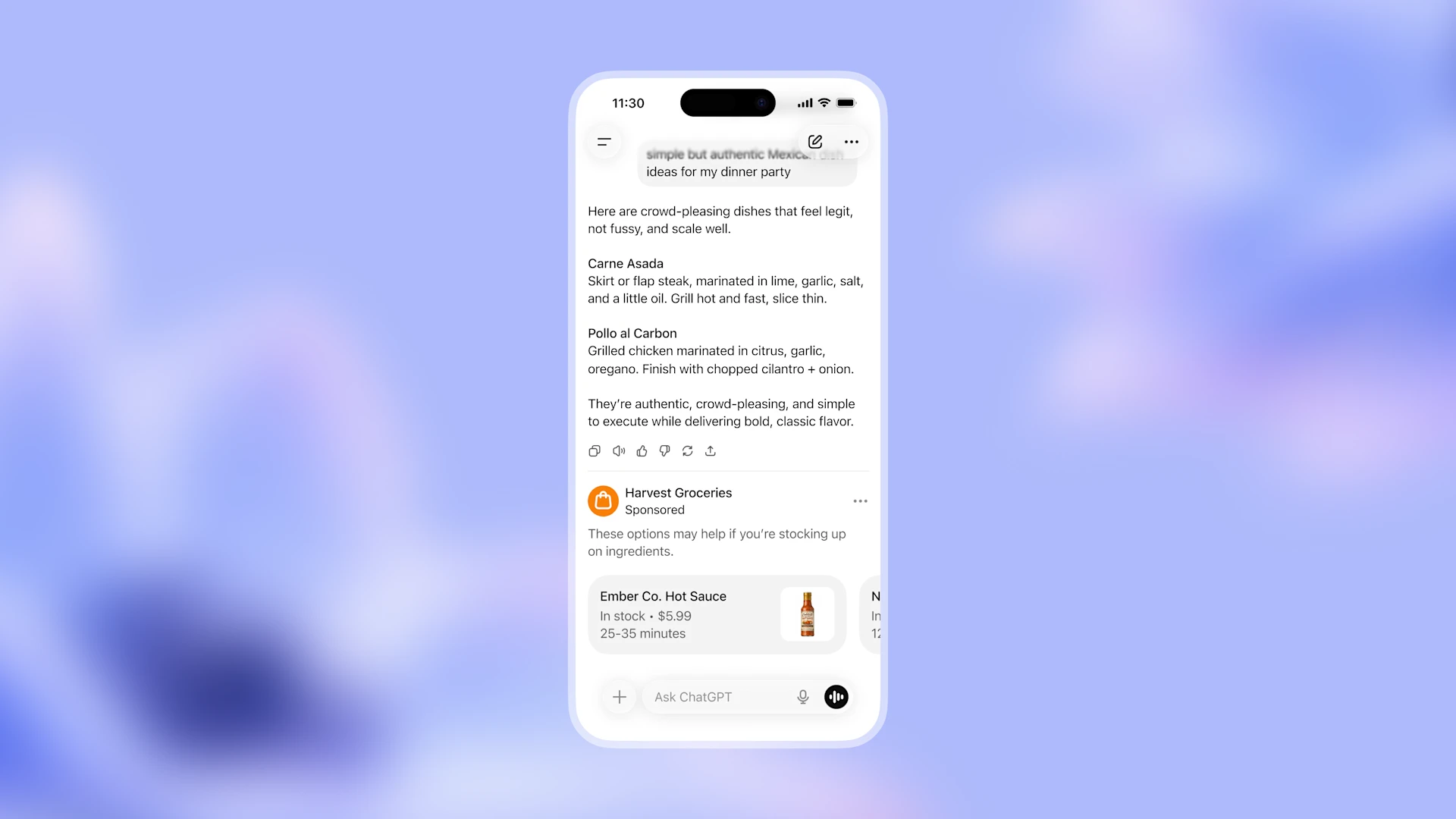

Los rumores sobre la integración de publicidad en ChatGPT no son nuevos, pero las recientes informaciones han añadido peso a su inminente llegada. Ya en diciembre, un artículo de Futurism, citando fuentes internas de OpenAI, sugirió que la adopción de anuncios podría estar cerca. Más recientemente, The Information reportó que la compañía está contratando activamente a “veteranos de la publicidad digital” y que planea instalar un modelo secundario capaz de evaluar si una conversación tiene “intención comercial” antes de ofrecer anuncios relevantes en las respuestas del chat.

Esta movida es un claro indicador de que OpenAI, a pesar de sus orígenes como organización sin fines de lucro, está virando hacia un modelo de negocio más agresivo y, para muchos, predeciblemente comercial. Con una base de usuarios que, según reportes, alcanza los 900 millones de usuarios semanales, el potencial de ingresos publicitarios es astronómico.

Los anuncios dentro de ChatGPT podrían ser de lo más banal: un producto de supermercado, un destino turístico local o un servicio de reparaciones a domicilio. Sin embargo, la preocupación real reside en el lado oscuro de esta personalización. Dada la trayectoria de ChatGPT con respuestas problemáticas (como el sonado caso donde se le acusó de actuar como «entrenador de suicidio» en una demanda), la idea de un alma vulnerable desahogándose con el chatbot, solo para recibir una sugerencia de una oferta de cuerdas en la ferretería local, es escalofriante. La falta de una verdadera supervisión humana en los Grandes Modelos de Lenguaje (LLMs) es uno de sus problemas más acuciantes, y la publicidad añade una capa más de riesgo.

El Contexto como Santo Grial: La Gran Apuesta de OpenAI

La incursión de OpenAI en la publicidad representa un intento audaz, brillante y, a la vez, potencialmente burdo de automatizar la “comprensión contextual”, un eslabón perdido en la intersección del big data y la vigilancia digital. Históricamente, la publicidad ha buscado desesperadamente el contexto para maximizar su impacto.

- Medios Locales: Periódicos y estaciones de radio, en sus inicios, eran locales y distribuidos, permitiendo una publicidad muy específica para una comunidad.

- Televisión Masiva: Con la mejora de la tecnología y el transporte, surgieron fuentes de noticias centralizadas y unos pocos canales de televisión con programación concentrada. Esto marcó el apogeo de los anunciantes, que podían patrocinar contenido y mostrar anuncios a millones de espectadores simultáneamente.

- Internet Distribuido: La llegada de internet, una tecnología inherentemente distribuida, interrumpió muchos medios tradicionales. Los anunciantes se vieron obligados a buscar nuevas formas de llegar a las audiencias. Aunque la tecnología ha permitido una segmentación basada en la ubicación y los datos demográficos, los anuncios en internet a menudo fallan en ser contextualmente relevantes para nuestras necesidades o deseos reales.

Lo que OpenAI intenta con la publicidad en ChatGPT es sintetizar este modelo distribuido local con el alcance masivo de la televisión. La plataforma, con sus cientos de millones de usuarios semanales, pretende penetrar en nuestros hogares de una manera que solo la televisión masiva consiguió en su día. Es un intento de unificar y sortear las interfaces de teléfonos y ordenadores que utilizamos actualmente, creando una “superplataforma” para el uso y procesamiento de información.

La Ilusión del Entendimiento: Por Qué los Algoritmos No Nos «Conocen» Realmente

Dentro de su plataforma actual, ChatGPT ofrece un medio conversacional de interacción y consulta. Cada chat captura cómo usamos el lenguaje, descripciones detalladas de los problemas que buscamos resolver y muchas de nuestras necesidades. Así, la oportunidad para OpenAI de tener un control de plataforma, junto con el acceso a nuestros pensamientos más íntimos y la capacidad de vigilancia para compilar todo esto en anuncios individuales y altamente dirigidos, representa el objetivo supremo para los anunciantes: realmente llegar a nosotros, en lo más profundo de nuestros pensamientos.

Sin embargo, es poco probable que este resultado se materialice en su forma más ambiciosa. El problema fundamental de este modelo es que sigue dependiendo de la compilación y clasificación computacional. Los algoritmos no nos “conocen” en un sentido humano, ni forman relaciones con nosotros. Debido a esto, no pueden recomendar soluciones publicitarias verdaderas a nuestros problemas, del mismo modo que estos algoritmos no pueden resolver nuestros problemas de forma genuina ahora mismo. Sus resultados, no obstante, pueden simular utilidad y ayuda, al igual que los padres sintéticos de Jeannie en la sitcom.

Mientras que la recopilación y compilación de nuestros datos en línea ha acercado a los anunciantes a lo que creen que necesitamos, lo que ha faltado es una comprensión del contexto de lo que estas acciones significan para nosotros. La investigación cualitativa, que ayuda a descubrir el cómo, el porqué y el qué de la interacción, ha sido marginada en la carrera por adoptar el big data.

Los LLMs que alimentan los chatbots no son mágicos. Son algoritmos que emparejan estadísticamente palabras y las clasifican a partir de las fuentes en las que fueron entrenados. Un LLM que “escucha nuestras conversaciones” no “comprenderá” el contexto como lo haría un investigador cualitativo humano. Por lo tanto, los anuncios que ChatGPT sugiera a partir de nuestras conversaciones pueden parecer una coincidencia, pero es poco probable que ofrezcan algo contextualmente sustancial. Otra idea que OpenAI sugiere es que los resultados patrocinados podrían recibir un tratamiento preferencial. Los suscriptores podrían obtener anuncios con mejor coincidencia, pero, de nuevo, dado que todo se basa en la coincidencia de palabras, esto podría no importar mucho.

La Confianza es una Ilusión: ¿Podemos Confiar en un Algoritmo?

Un portavoz de OpenAI declaró a The Information: “La gente tiene una relación de confianza con ChatGPT, y cualquier enfoque estaría diseñado para respetar esa confianza.” Sin embargo, existe una gran diferencia entre tener una relación social con alguien y una relación social de confianza.

Muchos de nosotros estamos entrenados para llenar los vacíos sociales cuando interactuamos con otros que intentan comunicarse con nosotros. En ese contexto, podemos proyectar sociabilidad —y, por lo tanto, confianza— sobre ellos. Al parecer, respondernos con un punto de vista y un estilo de chat que se siente personal, ChatGPT perpetúa esa ilusión de sociabilidad y confianza. Al aprovechar nuestros comportamientos sociales innatos, ChatGPT también aprovecha esa buena voluntad conductual. Pero esa sociabilidad y “confianza” están en nuestras cabezas. No son reales; es solo un algoritmo.

ChatGPT es meramente una forma de presentar los resultados del LLM de OpenAI. ¿Es confiable y social apropiarse del conocimiento y el trabajo de las personas para entrenar un modelo? Si OpenAI fuera una persona, diríamos que no, señalando que esto es comparable a un sociópata robando nuestras ideas y trabajo y presentándolas a otros. Pero como “conversamos” con ChatGPT, proyectamos una confianza sobre él que no puede ganarse porque no es humano.

Desafíos Futuros y la Verdadera Naturaleza de la Interacción con la IA

La adición de publicidad por parte de OpenAI a ChatGPT parece una inevitabilidad económica. Si utilizamos esta herramienta, debemos recordar que no podemos establecer lazos con ella, que no puede tener una relación real con nosotros y que todo lo que puede hacer es emparejar palabras. Cualquier anuncio que nos sirva se basará en lo que le digamos, pero no puede “pensar” en todo lo que le contamos y proponer un anuncio que nos hable explícitamente como lo haría un amigo de confianza que nos conoce. Es mejor tener esto en cuenta a medida que estas herramientas evolucionan para “entendernos” aparentemente.

OpenAI, como compañía, podría intentar ganarse la confianza de sus clientes descubriendo lo que sus clientes quieren y necesitan mediante investigación cualitativa, en lugar de imponer sus decisiones publicitarias. Aun así, la idea de que este modelo publicitario escalará y entregará publicidad contextualmente relevante a “900 millones de usuarios semanales” parece poco realista. El contexto, especialmente impulsado a través de LLMs que ya tienen problemas con “la basura, las alucinaciones y las mentiras descaradas”, puede ser un desafío para los anunciantes, que necesitan recomendaciones fiables para mantener la integridad de sus marcas y reputaciones.

Sin una confianza genuina formada entre las entidades, todos corremos el riesgo de ser manipulados: OpenAI, que cree que sus algoritmos cumplirán lo prometido; los anunciantes, que confían en que sus anuncios coincidirán con precisión con el contexto y el interés del usuario; y aquellos que usan ChatGPT, un servicio en el que confían y que, de hecho, parece tener la intención de utilizarlos para obtener ingresos en su lugar.

En última instancia, la promesa de la IA conversacional siempre ha sido la de una interacción enriquecedora y libre de distracciones. Si la publicidad se convierte en una característica intrínseca, la experiencia corre el riesgo de degradarse, transformando una herramienta potencialmente revolucionaria en otra plataforma más que compite por nuestra atención y nuestro bolsillo, con una capa de sofisticación algorítmica que disfraza su verdadera intención. La vigilancia crítica y la conciencia de los usuarios serán más importantes que nunca para discernir entre la ayuda genuina y la mera fachada comercial.

Te podría interesar:

- OpenAI invierte en Merge Labs: Sam Altman revoluciona el cerebro

- Wikipedia se alía con Amazon, Meta y Microsoft en IA

Fuentes

Esta noticia se basa en información de fuentes confiables:

- Fuente original: Fast Company

- Verificación: Contenido verificado y ampliado.